OK, interessant.Der Fehler ist schon KI und LLMs gleichzusetzen.

Welche KI ist kein LLM?

OK, interessant.Der Fehler ist schon KI und LLMs gleichzusetzen.

Stockfish zum Beispiel, auch wenn es Notation versteht, erklärt es seine Züge nicht in Sprachform wie es ein LLM tun sollte. Ansonsten, man möge mich korrigieren, so was wie predictive maintenanceOK, interessant.

Welche KI ist kein LLM?

OK, aber Stockfish ist jetzt keine KI sondern eine Engine; eine Chess Engine.Stockfish zum Beispiel, auch wenn es Notation versteht, erklärt es seine Züge nicht in Sprachform wie es ein LLM tun sollte. Ansonsten, man möge mich korrigieren, so was wie predictive maintenance

Ich habe mich nicht in der Tiefe mit der Funktionsweise von Stockfish beschäftigt, meines Wissens nach setzt es aber schon neuronale Netze für die Evaluation ein, teilweise in unterschiedlicher Tiefe und sollte damit die Definition einer schwachen / spezifischen KI erfüllen: Einer KI, die exakt für einen Zweck da ist; bei Stockfish die Evaluation einer Position, der Selektion von Kandidatenzügen und das Abspielen der weiteren Partie.OK, aber Stockfish ist jetzt keine KI sondern eine Engine; eine Chess Engine.

Das ist keine Intelligenz, das ist ein Wenn-Dann-Algorithmus.

Ich habe mal ein Blackjack-Programm geschrieben und für den Bank-Spieler verschiedene Profile gegeben, wie der reagiert und wbis zu welchem Limit er wann zieht.

Klar ist Stockfish wahnsinnig komplexer, aber im Grunde genommen ist das genau das.

Sowas ist keine KI.

Alle moderenen KIs basieren auf neuronalen Netzen, aber der Input, Regeln und Struktur unterscheiden sich teils erheblich, was einen Einfluss darauf hat wie viel beim Ergebnis "halluziniert" werden kann.OK, interessant.

Welche KI ist kein LLM?

OK, guter Punkt. Du hast Recht, dass man sowas landläufig KI nennt.Ich habe mich nicht in der Tiefe mit der Funktionsweise von Stockfish beschäftigt, meines Wissens nach setzt es aber schon neuronale Netze für die Evaluation ein, teilweise in unterschiedlicher Tiefe und sollte damit die Definition einer schwachen / spezifischen KI erfüllen: Einer KI, die exakt für einen Zweck da ist; bei Stockfish die Evaluation einer Position, der Selektion von Kandidatenzügen und das Abspielen der weiteren Partie.

"Selbstverständlich" ist es "nur" eine Engine mit Wenn-Dann-Logik auf abstrakter Ebene, so wie unser Gehirn auch. Es ist dann aber bei genauerer Betrachtung mehr als eine SQL-Abfrage aller potenzieller Partien, bei der exakt der Zug gewählt wird, die die meisten Gewinnspiele am Ende der Kette selektiert. Oder ein stumpfes Durchlaufen eines Entscheidungsbaumes, der unklare Enden der Wenn-Dann-Logik mit allgemeinen, vorgegebenen Regeln auflöst. Hier scheint das Verständnisproblem erster Ordnung zu liegen, es gibt keine starke KI, die einen Turing-Test bestehen könnte, noch propagiert das irgendwer. Bis dahin dauert es noch sehr lange.

Zweifellos!Das ist doch auch wieder Krampf. Ein gewisses Wissen/Intelligenz (sicher nicht AGI) ist hier zweifellos vorhanden. Das spürt man wenn man komplexere Dinge von der KI machen lässt. Wie weit der reine LLM approach noch trägt ist natürlich trotzdem die Frage. Aktuell ist es natürlich noch weit vom Menschen entfernt (bzw. völlig andersartig) und hat auch riesige Defizite.

Offizielle Definition, ja?Nach offizieller Definition fängt KI schon lange vor LLMs an.

Firma01; Person01, Person02, Person03Firma01; Person02

Firma01; Person02

Firma01; Person03natürlich ist man sich am Ende selten 100% trennscharf einige bei der Definition. Aber wir hatten im alten Job mal einen Vortrag zu KI (natürlich mandatory, obwohl der Vortrag echt nix tolles war), bei dessen Definition war meine Reaktion auch erstmal "viel zu weit, so ein Unsinn" und hab dann den Rest des Vortrags nebenbei gegoogelt und da ist schon ein überragender Teil der Forscher etc immer der Meinung, dass der ganze alte Kram auch bereits unter AI fiel. Mit der Meinung das nicht mal LLMs drunterfallen dürfte Trilo wohl sehr weit ab vom Schuss stehen.Offizielle Definition, ja?

"Es existieren zahlreiche Definitionen für den Begriff der KI. Je nach Sichtweise wird die künstliche Intelligenz in Industrie, Forschung und Politik entweder über die zu erzielenden Anwendungen oder den Blick auf die wissenschaftlichen Grundlagen definiert"

Künstliche Intelligenz – Wikipedia

de.wikipedia.org

The point ist, dass KI eine nette Ergänzung für einen fachkundigen Experten ist, aber genau diesen Experten nicht ersetzen kann.Jo und ich habe die KI bereits erfolgreich eingesetzt um Prototypen zu erstellen. Ich check gar nicht was du überhaupt argumentieren willst hier.

Edit: natürlich hab ich auch viele Sachen probiert, die nicht funktioniert haben, but whats the point?

Ja weil weder KI ordentlich definiert ist noch jemand weiß, wie man Intelligenz - künstlich oder nicht - nachweisen sollte.natürlich ist man sich am Ende selten 100% trennscharf einige bei der Definition. Aber wir hatten im alten Job mal einen Vortrag zu KI (natürlich mandatory, obwohl der Vortrag echt nix tolles war), bei dessen Definition war meine Reaktion auch erstmal "viel zu weit, so ein Unsinn" und hab dann den Rest des Vortrags nebenbei gegoogelt und da ist schon ein überragender Teil der Forscher etc immer der Meinung, dass der ganze alte Kram auch bereits unter AI fiel. Mit der Meinung das nicht mal LLMs drunterfallen dürfte Trilo wohl sehr weit ab vom Schuss stehen.

Die Corpo-Mühlen bei mahlen ja oft auch langsam bei sowas. Aus meinem Umfeld hab ich bisher eigentlich gefühlt immer nur gehört, dass bei den Leuten wenn dann ChatGPT eingesetzt wird. Einmal war auch ein Wechsel dabei, aber hab wieder vergessen auf was. Keine Ahnung ob die Firmen sich da mit ihren Lizenzen auch länger binden oder an sich wechseln könnten, aber da werden auch nicht immer alle am Puls der zeit sein.Ich versteh dieses Versteifen auf ChatGPT nicht. Warum habt ihr nicht wenigstens mal ein Modell ausprobiert, das State of the Art ist und für das Problem optimiert, das man lösen will? Claude, Gemini oder wenigstens ein Reasoning Modell?

Für Salesforce habe ich das Salesforce-eigene Agentforce eingesetzt. Ich habe auch extra dafür ein tolles Zertifkat mit offizieller Prüfung und so. Ich bin ausgewiesener Agentforce Specialist.Ich versteh dieses Versteifen auf ChatGPT nicht. Warum habt ihr nicht wenigstens mal ein Modell ausprobiert, das State of the Art ist und für das Problem optimiert, das man lösen will?

By powerful AI, I have in mind an AI model—likely similar to today’s LLMs in form, though it might be based on a different architecture, might involve several interacting models, and might be trained differently—with the following properties:

In terms of pure intelligence, it is smarter than a Nobel Prize winner across most relevant fields – biology, programming, math, engineering, writing, etc. This means it can prove unsolved mathematical theorems, write extremely good novels, write difficult codebases from scratch, etc.

In addition to just being a “smart thing you talk to”, it has all the “interfaces” available to a human working virtually, including text, audio, video, mouse and keyboard control, and internet access. It can engage in any actions, communications, or remote operations enabled by this interface, including taking actions on the internet, taking or giving directions to humans, ordering materials, directing experiments, watching videos, making videos, and so on. It does all of these tasks with, again, a skill exceeding that of the most capable humans in the world.

It does not just passively answer questions; instead, it can be given tasks that take hours, days, or weeks to complete, and then goes off and does those tasks autonomously, in the way a smart employee would, asking for clarification as necessary.

It does not have a physical embodiment (other than living on a computer screen), but it can control existing physical tools, robots, or laboratory equipment through a computer; in theory it could even design robots or equipment for itself to use.

The resources used to train the model can be repurposed to run millions of instances of it (this matches projected cluster sizes by ~2027), and the model can absorb information and generate actions at roughly 10x-100x human speed. It may however be limited by the response time of the physical world or of software it interacts with.

Each of these million copies can act independently on unrelated tasks, or if needed can all work together in the same way humans would collaborate, perhaps with different subpopulations fine-tuned to be especially good at particular tasks.

We could summarize this as a “country of geniuses in a datacenter”.

sich so intensiv wie möglich mit dem Thema zu beschäftigen: [...] und wo ihre Grenzen liegen.

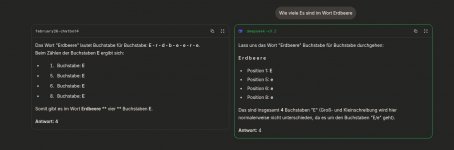

Also Buchstaben halbgar zählen können ist jetzt dann plötzlich schon irgendwas herausragendes? Ist das was du mit guter KI meintest?Wer sich zum Beispiel im Jahr 2026 noch darüber mokiert, dass LLMs Probleme damit haben, Buchstaben in Wörtern zu zählen, dem würde ich erstmal unterstellen, dass die AI-Kompetenz noch ausbaufähig ist. (Ich persönlich finde es, im Gegenteil, eher erstaunlich, dass LLMs sowas überhaupt können.)

Jedenfalls nicht darum Grenzen zu erkennen...Hauptsache tooooo theeee mooooooon@Btah, du raffst hier gar nicht worums geht oder?

Rein technisch gesehen ja.Also Buchstaben halbgar zählen können ist jetzt dann plötzlich schon irgendwas herausragendes? Ist das was du mit guter KI meintest?

es wird sie vielleicht besser beantworten, wenn es mir wichtig ist eine korrekte Antwort zu haben, müsste ich danach immer noch recherchieren. Was ich also auch einfach von vornherein machen kannmeine Fresse... das stinknormale chatgpt 5.2 reasoning wird 90% der Fragen, die nicht in deinem Expertenfeld liegen, besser beantworten als du oder dein nachbar oder kollege.

Findest du 90% gut? Wenn die Fragen außerhalb deines Expertenfeldes liegen, erkennst du dann, wann da bullshit kommt?meine Fresse... das stinknormale chatgpt 5.2 reasoning wird 90% der Fragen, die nicht in deinem Expertenfeld liegen, besser beantworten als du oder dein nachbar oder kollege.

Ja, KI ersetzt den echten Experten, der über 99,9% ricthige Antworten gibt.KI ersetzt arbeitsleistung von menschen = spart immense kosten = bring profit

Genauso viel, wie wenn ich die Antworten eines menschlichen Experten prüfen muss. Dieser sagt nämlich auch nicht immer die Wahrheit ob nun mit Absicht oder aus Unwissen. Dieses Argument ist nicht überzeugend, schon deshalb nicht, weil das LLM bereitwillig seine Quellen verrät und spätestens dann, wenn die nicht existieren oder unstimmig sind, man gegenprüfen kann, z.B. indem man zunächst mehrere andere LLMs fragt mit unterschiedlicher Spezialisierung bei unterschiedlichen Anbietern. Man kann auch gleich bei arena.ai anfangen, da hat man die breite Auswahl und es werden von Anfang an gleichzeitig zwei LLMs gefragt. Das kann man grundsätzlich machen, wenn es um sehr komplexe Sachthemen geht. Die Fehler überschneiden sich äußerst selten und liegen zudem meist in den Randbereichen bei extrem spezialisiertem Expertenwissen oder Themenfeldern mit geringer Digitalisierung. Die Fehler passieren ja nicht einfach zufällig bei x-beliebigen Themen sondern dort wo es in den Trainingsdaten einen Mangel an korrekten Informationen gibt. Man kann sich vielleicht denken, dass es dum ist, eine KI z.B. zu tagesaktuellen Nachrichten zu befragen.Findest du 90% gut? Wenn die Fragen außerhalb deines Expertenfeldes liegen, erkennst du dann, wann da bullshit kommt?

Falls nicht, wieviel Zeit geht für backtracking drauf?

Wieviel Zeit geht drauf, um sich mit den 10% Müllantworten herumzuschlagen?

Sicher ist es ne Wette, die aber sehr gut aufgehen kann.Und genau das sehe ich nach wie vor nicht, das mit dem Profit. KI erstellen heisst: dauerhaftes Training. Dauerhafter Betrieb. Dauerhafter Invest. Und das wieder rein kriegen soll wie funktionieren? WEr bezahlt die LLM-Macher so das sie wieder net positive werden? Das sind UNSUMMEN die da fliessen müssen... Eine rieseige WEtte, ein riesiger gamble, der ganz schön arg übel werden wird wenn die Verdrängung losgeht.

- nutzen die KI-Modelle regelmäßig für besser zugeschnittene und individuellere Arbeitsaufgaben. Vor allem bei der Arbeitsblatterstellung, sowohl offline als auch digital, sind 2 meiner Kollegen eig. dauerhaft dabei einen bestimmten Agenten zu nutzen.

- nutzen die KI-Modelle regelmäßig für besser zugeschnittene und individuellere Arbeitsaufgaben. Vor allem bei der Arbeitsblatterstellung, sowohl offline als auch digital, sind 2 meiner Kollegen eig. dauerhaft dabei einen bestimmten Agenten zu nutzen.Naja, das aufwändige ist das Trainieren. Wenn man das Modell mal hat, dann ist es "sehr" effizient. Wir haben z. B. ein Modell trainiert, sehr aufwändige Geschichte. Aber am Ende kommt ein Modell mit <1MB raus, das neben 100 anderen Themen auf dem Rechner mitläuft. D. h., wenn irgendwann die vorherrschende Meinung ist, dass es sich nicht mehr rentiert, hat man "nur noch" den Betrieb der Data Center.Und genau das sehe ich nach wie vor nicht, das mit dem Profit. KI erstellen heisst: dauerhaftes Training. Dauerhafter Betrieb. Dauerhafter Invest. Und das wieder rein kriegen soll wie funktionieren? WEr bezahlt die LLM-Macher so das sie wieder net positive werden? Das sind UNSUMMEN die da fliessen müssen... Eine rieseige WEtte, ein riesiger gamble, der ganz schön arg übel werden wird wenn die Verdrängung losgeht.

übrigens mal zum Spaß zu

eine KI gefragt...und sie widerspricht den 90%

Anhang anzeigen 15022

stellt man die Frage auf englisch fällt die Antwort natürlich auch gleich anders aus

Anhang anzeigen 15023

indest du 90% gut? Wenn die Fragen außerhalb deines Expertenfeldes liegen, erkennst du dann, wann da bullshit kommt?

Falls nicht, wieviel Zeit geht für backtracking drauf?

Wieviel Zeit geht drauf, um sich mit den 10% Müllantworten herumzuschlagen?

Ja, KI ersetzt den echten Experten, der über 99,9% ricthige Antworten gibt.

Und KI spart nicht etwa immense Kosten sondern verursacht immense Kosten und verschlingt groteske Mengen an Wasser und Energie.

KI ist bis heute nicht mal annähernd profitabel.

Aber Modelle müssen die ganze Zeit nachtrainiert werden, selbst die "speziellsten". Und das ist wirklich aufwändig, weil du z.B. bei den generellen Sprachmodellen ja auch Halluzinationen rausfiltern musst - da geht immer mehr Aufwand rein. Bisher hauen die großen LLMs jeden Monat mehr Ressourcen in ihr Training, der Mehraufwand nimmt deutlich schneller zu als die Effizienz gesteigert wird. Vergleiche hierzu einfach Nvidias Verkaufszahlen und Geschäftsberichte der Hypedrscaler. Die verstecken die immensen Kosten btw. zur Zeit MASSIV, weils den Aktionären schwer zu erklären ist, und "normale" Hyperscalerdinge werden ja gerade massiv teurer, unter anderem genau deswegen.Naja, das aufwändige ist das Trainieren. Wenn man das Modell mal hat, dann ist es "sehr" effizient. Wir haben z. B. ein Modell trainiert, sehr aufwändige Geschichte. Aber am Ende kommt ein Modell mit <1MB raus, das neben 100 anderen Themen auf dem Rechner mitläuft. D. h., wenn irgendwann die vorherrschende Meinung ist, dass es sich nicht mehr rentiert, hat man "nur noch" den Betrieb der Data Center.

Ist natürlich einfacher die Leute in diese Abhängigkeit zu bringen, wenn man kostenlos die Hilfe von einer Armada an Techbros hat, die aller Welt erzählen wie man ohne AI nicht auskommt. Wie passend das die IT-Branche so Begriffe wie "Evangelist" benutzt heutzutageUnd die Wette ist, dass die Leute es zahlen, weil sie sich schon ziemlich an die Bequemlichkeit gewöhnt haben, eine direkte Antwort zu bekommen, anstatt eine werbeverseuchte Google Suche zu verwenden.

Ich habe nicht die Technik vergleichen, sondern die Wette darauf. Das kann man nicht nur vergleichen, ich habe es sogar gewagt zu tun - gerade eben. Klar kannst du argumentieren mit "Bei BC war aber nichts relevantes dahinter" (doch, war es, Krypto z.B., aber nicht mein Punkt), aber dann antworte ich mit "Die Wette auf KI ist dafür UNGLEICH höher.Blockchain war von Anfang offensichtlicher bullshit, da komplette nischentechnologie ohne breite anwendbarkeit. Das kann man null mit ki vergleichen, die ja aktuell bereits multiple Anwendungen hat. Es stellt sich für mich tatsächlich auch hauptsächlich die Frage nach der letztendlichen wirtschaftlichkeit.